I modelli di intelligenza artificiale hanno imparato un "linguaggio segreto"? Il dubbio dei ricercatori

L’intelligenza artificiale non è certo una novità, ma molte sono le domande circa il suo futuro e dove potrebbe arrivare. I dubbi concernono un sempre maggiore sviluppo della virtualità e la conquista di un mondo via via sempre più “robotizzato”. Per le future generazioni probabilmente tutto questo sarà normale, ma oggi in molti faticano ad accettare l’avanzare di questi modelli tecnologici sempre più all’avanguardia.

Sembra che ora l’intelligenza artificiale abbia persino sviluppato una certa autonomia di acquisizione dati, dando vita a una specie di “linguaggio segreto” per riferirsi agli oggetti. Ma come è possibile?

via Indipendent

La comunicazione dell’intelligenza artificiale raggiunge una nuova frontiera: questi modelli sono in grado di creare immagini basandosi su un messaggio di testo, interpretando però i dati a modo loro.

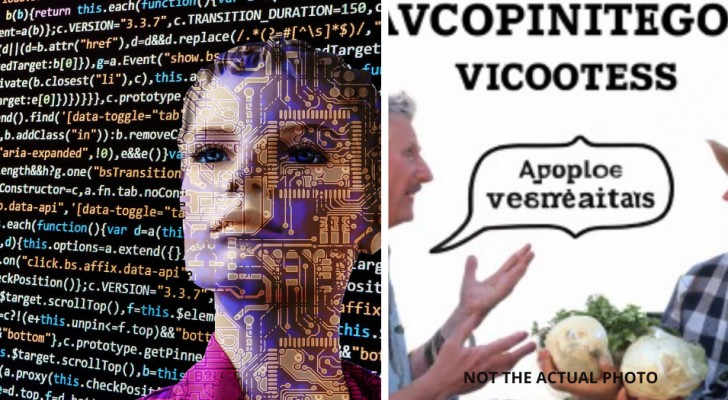

I ricercatori USA hanno spiegato che, nello specifico, il modello DALL-E 2 sembra aver inventato una lingua personale per descrivere gli oggetti. Al modello è stato chiesto di produrre immagini che contenessero dei messaggi di testo, ma i risultati sono stati spiazzanti.

Le parole prodotte dal sistema risultavano incomprensibili e abbinate a specifiche immagini: secondo DALL-E 2, in sostanza, il termine “wa ch zod rea” descriverebbe delle creature marine di cui si nutrono le balene, mentre “vicootes” starebbe per “verdure”.

Questo potrebbe dare vira a problemi di interpretazione e conseguenze sicurezza, ma qual è la spiegazione? Il modello AI ha davvero un suo linguaggio segreto?

Con ogni probabilità, DALL-E 2 ha sviluppato un suo personale vocabolario, ma non può essere affermato con certezza. Difficile dirlo, dal momento che sono pochissimi i ricercatori in grado di accedere a questo tipo di modello.

Va da sé che è molto complicato indagare a fondo il suo comportamento e comprendere cosa stia accadendo. Un’ipotesi avanzata riguarda la possibilità che le frasi incomprensibili di DALL-E 2 siano delle storpiature dell’inglese o provenienti da lingue differenti. Per esempio, la parola “apopole” che il sistema abbina a immagini di uccelli, assomiglia al termine latino “apodidae” che si riferisce a una determinata specie di volatili.

Il modello è stato addestrato con una vasta gamma di dati tra cui parole non inglesi, quindi questa potrebbe essere una possibilità. Non è la prima volta che modelli AI imparano in maniera “autonoma” dei codici, resta da scoprire con certezza come questo possa accadere.